2. 北京林业大学, 北京 100083;

3. 马钢(集团)控股有限公司姑山矿业公司, 安徽 马鞍山 243000

2. The College of Forestry of Beijing Forestry University, Beijing 100083, China;

3. Magang (Group) Holding Co., Ltd., Gushan Mining Company, Maanshan 243000, China

作为城市区域的重要构成要素,城市道路是城市地形的骨架,也是城市内部信息与物质流动的关键通道。城市道路的高精度提取可为城市三维表达、地理环境构建、城市地形分析、城市建设规划、车辆导航等方面提供数据基础和技术支撑[1-5]。

目前,针对城市道路提取的研究主要体现在城市道路提取对象和提取方法两个方面。城市道路提取的对象偏向于城市道路面及道路骨架线或边界线,近些年趋向于细粒度城市道路附属提取(如标识线、路灯和路坎等)[6-12]。而数据源主要集中在遥感影像[6-8]、无人机影像[1, 9]及点云数据[10-13]、轨迹大数据[14]等,特别是以高分遥感影像和车载(机载)点云数据为主。城市道路提取方法因数据源和提取对象的不同而异。针对遥感影像的道路信息提取,其方法从像元到对象,再到机器学习和人工智能。其中,针对像元的城市道路提取方法主要有光谱分析法、阈值分割法、边缘检测法等[6, 15-16];面向对象的方法包括支持向量机、隶属度函数、知识模型等[5, 17-18];在遥感图像道路提取的方法中主要用到的深度学习算法有深度卷积网络、完全卷积网络及深层神经网络等[3, 19-23]。利用点云数据提取道路一直是国内外众多学者关注的问题之一[10-13, 24-26],目前基于点云提取城市道路及相关附属信息的研究主要集中在机载点云和车载点云两个方面,主要借助点云的强度、高度、光谱等信息或使用滤波等方法。然而基于以上数据及相关方法的城市道路自动提取结果,常因阴影、遮挡、噪声、分辨率及同谱异物或同物异谱等原因导致城市道路提取出现边界信息不全、数据精度不高等问题,且高质量数据获取较为困难,价格也十分昂贵。虽然基于深度学习的方法已成为热点,但利用此方法时需要大量的训练样本进行训练,对计算机的要求较高,且遮挡面积较大的道路仍会被漏提。

作为免费获取的数据源,开源道路网和街景数据逐渐进入研究者的视野[27-30],特别是街景数据的获取方式及其立面视角可解决城市道路被遮挡的问题,可为高精度和细粒度的城市信息提取提供参考。然而,现有文献鲜见综合运用开源道路网、街景图像等数据进行城市道路要素提取的报道。基于此,本文综合运用矢量道路网、街景图像和遥感影像等数据,开展多源数据协同的高精度城市道路提取方法研究,以期为城市规划、交通导航、三维表达等提供参考,为开源数据的广泛应用提供借鉴。

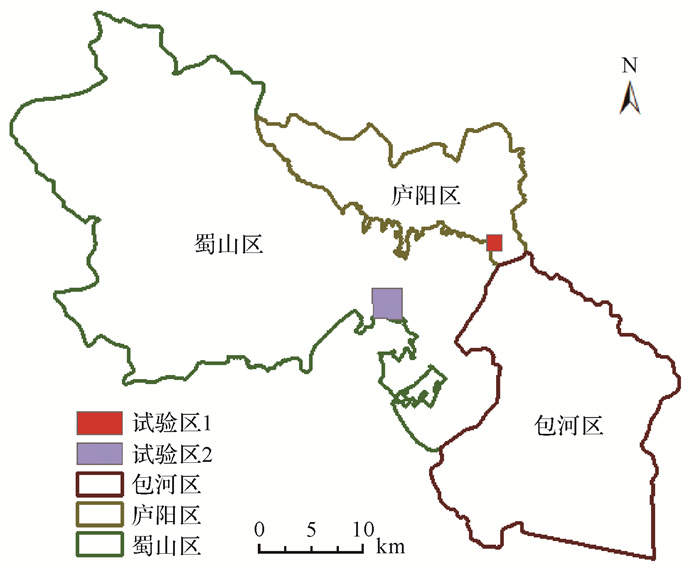

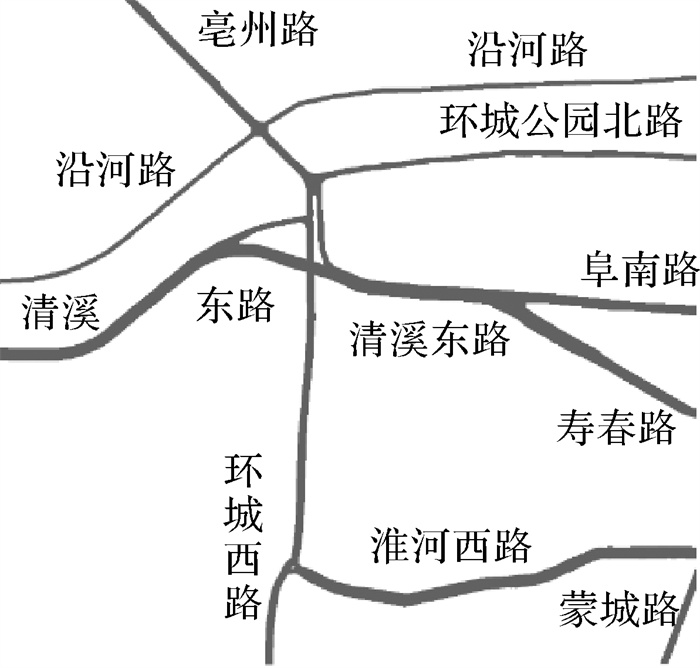

1 研究区与数据源 1.1 试验区概况共有两个试验区,其中合肥市蜀山区、庐阳区交界附近区域为试验区1,如图 1中红色区域。试验区内有合肥市图书馆、省财政厅、合肥市公安局等重要机构,黑池坝、南淝河等水域及杏花公园,境内有主要道路清溪东路、寿春路等主干一级道路,环城西路、环城公园北路、阜南路、淮河西路,沿河路等三级及以上道路,黑池坝路等居民区道路。试验区2为合肥市蜀山区大蜀山国家森林公园南侧区域(如图 1紫色区域所示)。试验区内道路类型丰富,结构相对完整、宽窄不一,纵横交错,微起伏延伸,且试验区域内部分道路两旁具有高大植被,易被遮挡,具有代表性。

|

| 图 1 试验区地理位置 |

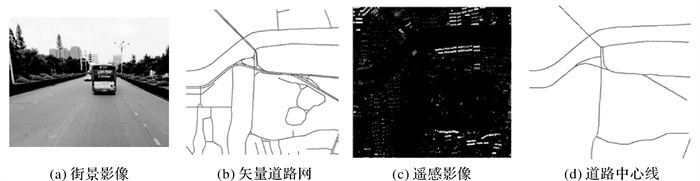

试验数据分别为开源路网数据、街景图像和遥感数据,如图 2所示。其中道路网数据从OpenStreetMap平台获取;开源地图中的街景数据依据设定的采样点坐标利用百度URL进行下载,街景影像尺寸为480×640像素,每个采样点处的垂直视角取0°,水平视角从0°开始每隔60°获取一张,并以前进方向的图像为主图,视场角为120°;遥感影像为WorldView-3数据,全色分辨率为0.31 m,同时包含8个分辨率为1.2 m的多光谱波段,并对遥感影像进行了数据融合、大气校正及几何校正等预处理。试验区2中的影像来源为高德地图,分辨率为0.51 m,具有R、G、B 3个波段。

|

| 图 2 试验区数据 |

因研究对象主要是具有规则且相互连通的城市高等级道路,且每条道路对应一条中心线,故对开源路网数据进行了数据筛选、栅格化、空洞填充和矢量化等处理[30],获取了包含城市三级以上道路的中心线数据(如图 2(d)所示),其中栅格化的格网分辨率设置为5 m,栅格填充尺寸为10 m。

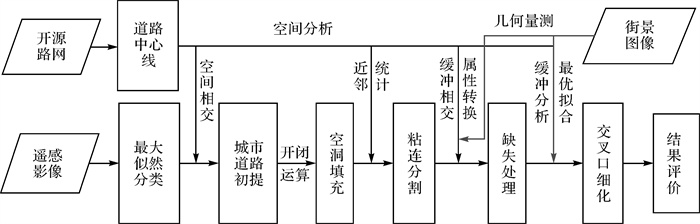

2 研究方法 2.1 研究技术路线本文的城市道路被界定为具有较高等级的城市道路,即城市高速公路、城市主干道、次干道及主要支路等三级以上道路。为保持道路的连通性与整洁性,小区道路出入连接口及小区内部道路不在研究范围内。通过实地调研与开放地图可以看出,城市道路几何上呈长条形延伸状态,且单一高等级道路的宽度基本保持不变或渐变,很少出现突变现象。因此在城市道路边界基本平行的前提下,进行城市道路提取。首先,利用最大似然法进行遥感影像分类提取城市道路,并利用开源路网删除与城市道路不粘连的错分对象,获取初步提取结果。然后,利用缓冲分析、最小距离分析、统计分析等空间分析方法及几何量测原理对空洞、粘连区域及缺失边界进行处理;进而对被遮挡区域进行识别和修复;最后,对交叉路口进行识别和边界完善。技术流程如图 3所示。

|

| 图 3 技术流程 |

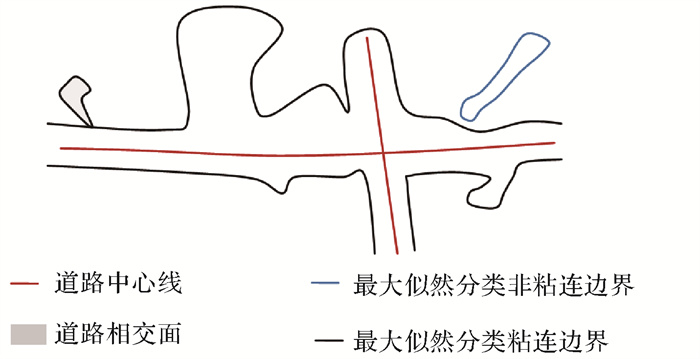

针对遥感影像的城市道路提取方法,相对较早及成熟的有监督分类和非监督分类方法,其中最大似然法为监督分类方法中的有效方法之一。此方法具有分类速度快、方法简单,但分类精度不高等特点。本文在最大似然提取结果上,利用道路中心线通过空间相交方法剔除不粘连的非道路面数据作为初提取结果,其中相交处理原理如图 4所示。

|

| 图 4 非粘连面剔除 |

在单条城市道路宽度变化不大的前提下,本文提出了基于射影几何的城市道路面分割处理方法,具体如下。

(1) 空洞填补。利用数学形态学原理,进行道路面上小斑块的空洞填充。

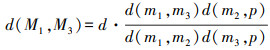

(2) 宽度量取。由射影几何可知,现实空间平行的一组直线不再平行,而是汇聚在灭点处,且一个平面上只有一个灭线,由所有的灭点连接而成。依据几何量测原理,若已知图像中参考线段的长度,可计算两点之间对应的现实空间距离[31],距离计算公式为

(1)

(1)  (2)

(2) 式中,d(Mi, Mj)为空间两点之间的距离;d(mi, mj)为图像上两点之间的距离;cr1为m的四点构成的交比;p为四点组成直线的灭点。

街景图像是通过相机拍摄的局部照片,其物体几何关系符合射影几何规则。同时,道路标识线的宽度在《城市道路交通标志和标线设置规范》(GB 51038—2015)等中均有明确规定(10~15 cm)[32-33]。基于此,可用道路标识线作为参考线通过编程对任意采样点对应的街景图像道路宽度d进行量测,并将其以属性方式赋予采样点及对应中心线,同时求取试验区道路宽度最大值dmax和最小值dmin。

(3) 间隔点获取。将无空洞的面数据转成线数据,并对线数据以一定间隔(K=dmin)获取间隔点数据,利用近临分析获取每个点到道路中心线的距离,进而删除距离大于dmax的点。

(4) 统计分析。结合城市道路设计规范,以道路属性为区分,以3像素为步长(人工进行道路边界标识时,其边界精度一般在2~3像素范围内),对剩余间隔点到归属中心线的距离分别进行分段统计,得到频率最高的区域,超出或小于频率最大区域值的点删除。值得注意的是,此处若两个区的频率远超出其他统计区,则这两个高频区域的点均被保留。

(5) 对步骤(4)剩余的点进行连接和平滑,得到道路边界线。

2.2.3 缺失处理城市道路两旁绿化带植被生长旺盛或周边建筑遮挡及同物异谱等,会导致提取后的城市道路数据存在路面缺少和道路宽度缩减等现象,此现象被定义为道路缺失。缺失道路处理方法分为两个主要步骤,分别是道路缺失识别和道路缺失修复。

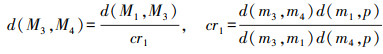

(1) 道路缺失识别。依据宽度属性对城市道路中心线做缓冲面,并针对此缓冲面与粘连分割处理后的结果,进行空间相交计算,获取其相交区域面积占缓冲道路面面积的比值r,其公式为

(3)

(3) 式中,SBUF表示缓冲区域;SCUR表示当前缺失处理前道路面域;A表示面积;ABUF表示缓冲区域面积;r表示相交比值。若相交比值小于95%,且缓冲面数据中非相交的差异道路面的宽度大于3倍像元,即判断此道路两侧被遮挡或存在缺失(其中道路内部被遮挡、道路出现小部分断裂等问题在上节可被处理)。

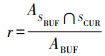

(2) 道路缺失修复。获取存在缺失的道路中心线,对此路以50 m为间隔采样[30],量取采样点处道路宽度,过采样点做垂直于中心线的宽度辅助线,并将宽度辅助线端点作为道路边界点,进而对其进行连接及平滑处理(如图 5所示)。

|

| 图 5 道路边界缺失修复 |

以中心线相交的角度状态表达道路口边界会丢失原有道路交叉口接连状态(如圆弧形等),而部分道路交叉口通过遥感分类方法其形态保持良好,特别是在区域边界光谱区分度较大的情况下。为减少程序运行量,作如下处理。第一,确定交叉口位置。城市道路中心线的交点即为交叉口所在位置。第二,获取缓冲区域面数据。以交叉点为中心,以阈值ρ为缓冲半径获取经过初分类后的交叉口面域缓冲区,其中将试验区内最高等级道路交叉口的最小外包圆半径赋给ρ,即缓冲区半径。第三,最优边界拟合。对缓冲区域面的边界线转成点并进行最优拟合。此步骤可以去掉初分类结果的毛边,使边界相对平滑。第四,交叉口融合。将处理后的缓冲区面域与当前缺失处理后的道路数据进行融合,恢复交叉口状态。

最小二乘拟合是常见的数据优化拟合方法,可用于输入模型和训练集模型的学习。本文利用其处理道路交叉口边界的毛刺和抖动等问题。其本质是通过将误差的平方和最小化的方式寻找数据的最佳函数匹配。即若存在函数y=f(x),求多项式且应满足的条件为

(4)

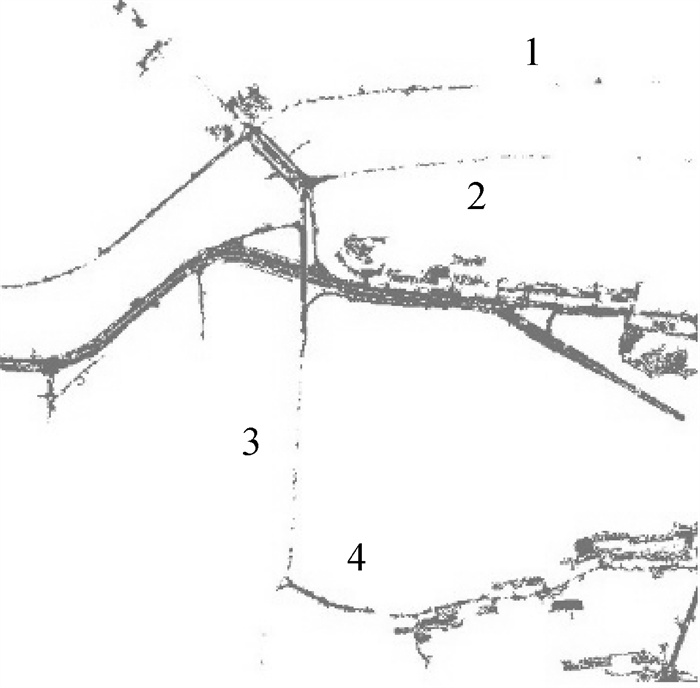

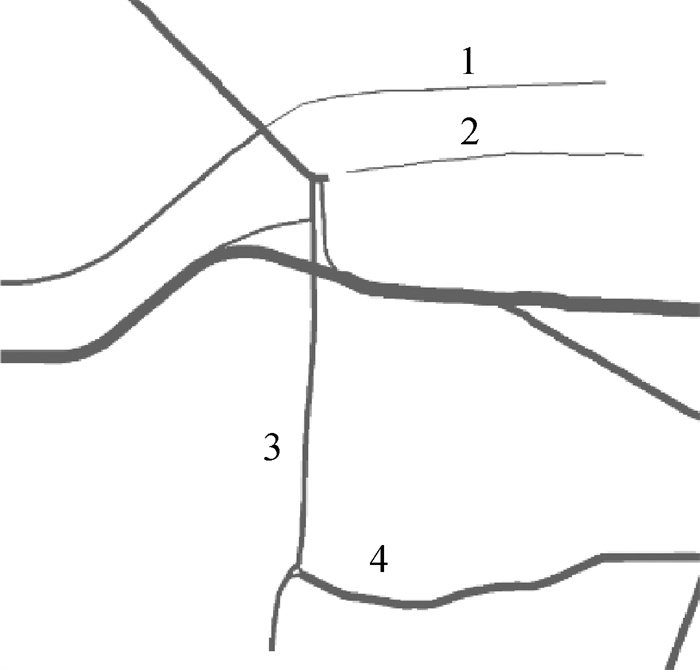

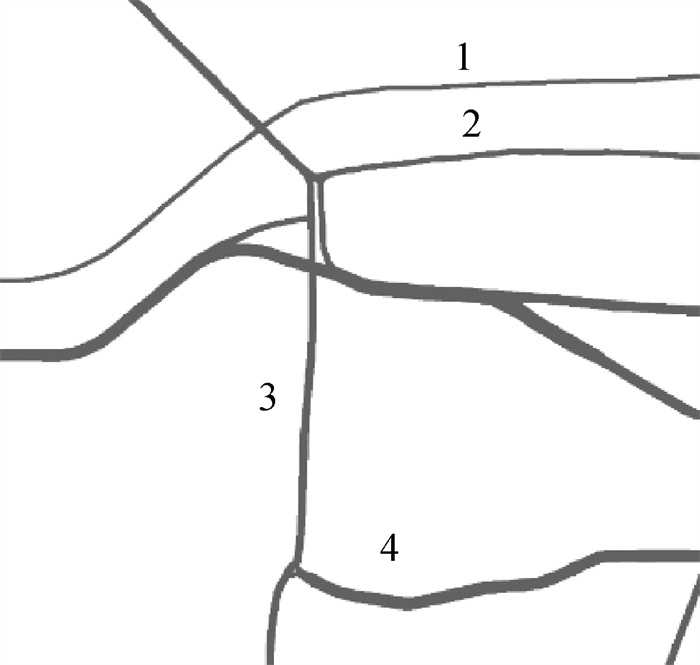

(4) 在最大似然分类去除非粘连的基础上(如图 6所示),进行空洞填充和边界粘连处理(如图 7所示)、大区域缺失处理(如图 8所示)及道路交叉口处理,得到最终的城市道路提取结果(如图 9所示),并将面域内部填充透明色与遥感影像套合(如图 10所示)。可以看出,最大似然提取的非城市道路被错分现象已被清除,城市道路整体形态规整、图 6和图 7中4处标记处(沿河路东段、环城公园北路、环城西路及淮河西路部分路段)的道路缺失已被修复,道路边界信息基本完整,且提取边界与遥感影像套合度良好。

|

| 图 6 最大似然去除非粘连 |

|

| 图 7 粘连分割 |

|

| 图 8 缺失修复 |

|

| 图 9 本文方法提取结果 |

|

| 图 10 本文结果与影像套合 |

|

| 图 11 面向对象提取结果 |

为验证方法的有效性,本文进行了基于面向对象的城市道路提取[34],并利用道路中线删除高等级以外的道路对象,从而使提取对象与上文保持一致,结果如图 11所示。从图 11可以看出,基于面向对象的城市道路能够较好地提取城市道路对象,且粘连现象较少,提取效果明显优于最大似然分类结果,但是被植被遮挡的城市道路区域仍未能被提取。通过总体分类精度和Kappa系数2个指标对最大似然分类、面向对象和本文方法3种方法得到的提取结果进行了精度评定(见表 1)。

因本文的提取对象为城市三级以上道路,其余道路不在本文研究范围内,因此在进行基于样本的混淆矩阵计算时,道路样本的选择在高等级城市道路范围内。从表 1可以看出,本文方法的总体精度为96.65%,Kappa系数为93.71%,面向对象方法的总体精度为89.36%,Kappa系数为80.08%,而利用最大似然方法提取结果的总体精度为65.22%,Kappa系数为60.82%。从以上数据可以看出不管是提取总体精度还是Kappa系数,本文方法的数值均大于文中其他两种方法,其次为面向对象分类方法,最后为最大似然法。

为进一步检验提取道路宽度的准确性,本文沿城市道路中心线以300 m为采样间隔生成了26个验证点,并将经实地测量的验证点宽度当作参考真值,统计了参考真值与以上3种方法获取的道路宽度之间的差值,统计结果见表 2。其中最大似然分类方法提取的道路宽度与真值的差值用似然-差值表示,用对象-差值表示基于面向对象方法提取的道路宽度与真值之差,而基于本文方法获取验证点处宽度与参考真值之差用本文-差值表示,且各差值为绝对值。从表 2中可以看出,城市道路面提取宽度与真值宽度的差值普遍偏小,最大偏离值为0.11 m,最小值为0.01 m,平均值为0.05 m,偏离中误差为0.03 m。而基于面向对象方法提取的城市道路差值统计结果中,最小差值为0.03 m,最大差值为13.92 m,平均值为4.20 m,偏离中误差为4.42 m。基于最大似然分离提取的结果中最大值为18.2 m,最小值为0.18 m,平均偏差为5.8 m,偏离中误差为5.2 m。可以看出,导致最大似然和面向对象方法获取的数据误差较大的主要原因是环城公园北路、淮河西路及亳州路等道路出现信息提取不全。而本文的提取方法可以较好地避免此问题。其次,因“同物异谱”和“同谱异物”造成的提取宽度大于实际宽度的现象在最大似然分类方法中最为严重,面向对象次之,本文方法较好。综上,本文提取方法能较好地提取城市高等级道路,且提取精度较传统方法较高。

| m | |||||||||||||||||||||||||||||

| 验证点 | 道路名 | 似然- 差值 |

对象- 差值 |

本文- 差值 |

验证点 | 道路名 | 似然- 差值 |

对象-差 值 |

本文- 差值 |

||||||||||||||||||||

| 1 | 沿河路 | 4.33 | 0.4 | 0.03 | 14 | 淮河西路 | 13.1 | 13.92 | 0.02 | ||||||||||||||||||||

| 2 | 沿河路 | 2.92 | 0.69 | 0.01 | 15 | 淮河西路 | 6.76 | 0.93 | 0.08 | ||||||||||||||||||||

| 3 | 沿河路 | 1.49 | 5.02 | 0.08 | 16 | 寿春路 | 2.29 | 3.22 | 0.02 | ||||||||||||||||||||

| 4 | 沿河路 | 1.8 | 0.69 | 0.04 | 17 | 清溪东路 | 0.34 | 0.26 | 0.05 | ||||||||||||||||||||

| 5 | 沿河路 | 9 | 9 | 0.05 | 18 | 清溪东路 | 3.28 | 5 | 0.11 | ||||||||||||||||||||

| 6 | 环城公园北路 | 2.73 | 2.78 | 0.04 | 19 | 清溪东路 | 1.48 | 4.62 | 0.08 | ||||||||||||||||||||

| 7 | 环城公园北路 | 11.06 | 0.05 | 0.07 | 20 | 清溪东路 | 7 | 0.68 | 0.03 | ||||||||||||||||||||

| 8 | 环城公园北路 | 10.98 | 10.98 | 0.04 | 21 | 清溪东路 | 3.4 | 0.01 | 0.09 | ||||||||||||||||||||

| 9 | 环城西路 | 3.91 | 1.97 | 0.08 | 22 | 亳州路 | 15 | 15 | 0.01 | ||||||||||||||||||||

| 10 | 环城西路 | 10.54 | 2.03 | 0.05 | 23 | 亳州路 | 0.8 | 11.22 | 0.09 | ||||||||||||||||||||

| 11 | 环城西路 | 13.51 | 3.01 | 0.03 | 24 | 阜南路 | 0.29 | 5.01 | 0.03 | ||||||||||||||||||||

| 12 | 环城西路 | 3.42 | 7.24 | 0.02 | 25 | 阜南路 | 0.18 | 3.02 | 0.01 | ||||||||||||||||||||

| 13 | 淮河西路 | 18.22 | 0.03 | 0.09 | 26 | 蒙城路 | 2.93 | 2.41 | 0.09 | ||||||||||||||||||||

为了验证本方法的适用性,利用含有R、G、B 3个波段的遥感影像(来源高德地图,分辨率为0.51 m)对试验区2进行了试验分析。初步分类结果、提取结果及提取后套合结果如图 12所示。可以看出本文提取的城市道路形态基本完整且与遥感影像套合度较好,提取总体精度为96.36%,Kappa系数为92.17%。而利用最大似然法分类的总体精度为78.01%,Kappa系数为71.05%。由此可知,本文的提取方法能够有效提取城市高等级道路,且本文方法对于影像的要求不高,适用于具有3个波段的图像。值得说明的是,为了便于导航或车辆导流,高等级城市道路往往具有2条或以上道路中心线,而本次附加局部试验过程的处理方法与上述原理方法相同,但未将具有两条中心线的高等级道路进行合并处理。在这种情况下将会出现具有正反流向的同一条道路将会被当作2条道路处理,中间的空白空隙为隔离带区域。

|

| 图 12 提取结果对比 |

本文在城市道路界定为等级道路及“单条城市道路宽度不存在突变”的前提下,利用遥感影像对城市道路进行初分类,进而协同开源道路网数据、街景图像在初分类的基础上,建立了空洞填充、边界粘连、大区域遮挡性缺失和交叉口细化等问题的处理方法,最后对试验结果进行了精度评定和分析。试验结果表明:①本文方法能够较好地提取城市道路,提取总体精度为96.63%,Kappa系数为93.71%,偏离中误差为0.03 m,各项指标优于另外两种方法。②本文方法可较好地解决“同谱异物”“同物异谱”及遮挡等造成的边界信息提取不全等问题。

值得注意的是,本文未考虑小区内部的道路、部分支路及一些连接口,且城市道路提取的完整度取决于开源路网数据的完整度(如在阜南路和寿春路交叉口附近还有小段弧形连通路段,但是因开源路网中没有此段道路,故未被提取),后续需要结合遥感提取结果确保道路的完整。由于参数的大小对本试验的影响较小,故在进行参数设置时参考了同类试验并结合经验和规范进行确定。同时在进行混淆矩阵精度评定时,忽略了样本的选择对评价结果的影响,且后续对交叉口细化部分仍需要做进一步研究。从以上研究结果可以看出,本文方法在遥感影像波段不多(R、G、B 3个波段)的情况下也可以完成,通过本文方法基于无人机影像及三波段图片进行城市道路的提取,后续需要进一步验证。另外,从拓展试验可以看出未进行中心线合并的高等级城市道路更符合道路街景拍摄情景。

| [1] |

李磊. 一种基于无人机倾斜摄影的三维路网提取方法[J]. 中国公路学报, 2019, 32(11): 219-226. |

| [2] |

杨灿灿, 江岭, 陈昕, 等. 面向城市DEM构建的地形要素分类及表达[J]. 地球信息科学学报, 2017, 19(3): 317-325. |

| [3] |

YANG C, ZHAO M, WANG C, et al. Urban road DEM construction based on geometric and semantic characteristics[J]. Earth Science Informatics, 2020, 13(1): 1369-1382. |

| [4] |

郭庆胜, 刘洋, 李萌, 等. 基于网格模型的导航道路图渐进式化简方法[J]. 测绘学报, 2019, 48(11): 1357-1368. |

| [5] |

张永宏, 何静, 阚希, 等. 遥感图像道路提取方法综述[J]. 计算机工程与应用, 2018, 54(13): 1-10. DOI:10.3778/j.issn.1002-8331.1804-0271 |

| [6] |

赵文智, 雒立群, 郭舟晖, 等. 光谱特征分析的城市道路提取[J]. 光谱学与光谱分析, 2015, 35(10): 2814-2819. |

| [7] |

SHI W, MIAO Z, DEBAYLE J. An integrated method for urban main-road centerline extraction from optical remotely sensed imagery[J]. IEEE Transactions on Geo-science & Remote Sensing, 2014, 52(6): 3359-3372. |

| [8] |

苗则朗, 史文中, 张华. 一种高分辨率影像道路中心线提取算法[J]. 中国矿业大学学报, 2013, 42(5): 887-892. |

| [9] |

何涛. 无人机影像在高速公路检测中的应用分析[J]. 中国设备工程, 2019(20): 108-109. DOI:10.3969/j.issn.1671-0711.2019.20.063 |

| [10] |

曾妮红. 基于车载LiDAR点云数据的滤波及道路标识线提取研究[D]. 武汉: 中国地质大学, 2016.

|

| [11] |

蒋腾平, 王永君, 陶帅兵, 等. 功能性规则约束下的三维点云道路设施语义标注[J]. 南京师范大学学报(工程技术版), 2018, 18(4): 52-58. DOI:10.3969/j.issn.1672-1292.2018.04.008 |

| [12] |

范雯, 何鄂龙, 李天琪, 等. 融合空谱特征的车载LiDAR点云道路标识线提取[J]. 测绘通报, 2018(8): 97-101. |

| [13] |

张爱武, 刘路路, 张希珍. 道路三维点云多特征卷积神经网络语义分割方法[J]. 中国激光, 2020, 47(4): 269-277. |

| [14] |

YANG W, AI T H, LU W. A method for extracting road boundary information from crowdsourcing vehicle GPS trajectories[J]. Sensors, 2018, 18(4): 1261-1283. DOI:10.3390/s18041261 |

| [15] |

周家香, 周安发, 陶超, 等. 一种高分辨率遥感影像城区道路网提取方法[J]. 中南大学学报(自然科学版), 2013, 44(6): 2385-2391. |

| [16] |

谭媛, 黄辉先, 徐建闽, 等. 基于改进Sobel算子的遥感图像道路边缘检测方法[J]. 国土资源遥感, 2016, 28(3): 7-11. |

| [17] |

张曦. 基于时频特征和支持向量机的高分辨率遥感影像道路提取[D]. 合肥: 安徽大学, 2016.

|

| [18] |

陈杰, 邵权斌, 梅小明, 等. 结合尺度空间的面向对象高分辨率影像城市道路提取[J]. 测绘工程, 2016, 25(12): 5-11. |

| [19] |

LI P, ZANG Y, WANG C, et al. Road network extraction via deep learning and line integral convolution[C]//Proceedings of 2016 IEEE International Geoscience and Remote Sensing Symposium. Beijing: IEEE, 2016: 1599-1602.

|

| [20] |

CHENG G, WANG Y, XU S, et al. Automatic road detec-tion and centerline extraction via cascaded end-to-end convolutional neural network[J]. IEEE Transactions on Geoscience & Remote Sensing, 2017, 55(6): 3322-3337. |

| [21] |

GAO J, WANG Q, YUAN Y. Embedding structured cont-our and location prior in siamesed fully convolutional net-works for road detection[C]//Proceedings of 2017 IEEE International Conference on Robotics and Automation. Singapore: IEEE, 2017: 219-224.

|

| [22] |

MOHAN R. Deep deconvolutional networks for scene pars-ing[J]. Computer Science, 2014(1): 1-8. |

| [23] |

赵阳. 基于深度学习的遥感图像道路提取[D]. 西安: 西安电子科技大学, 2019.

|

| [24] |

YANG B, FANG I L, LI Q. Automated extraction of road markings from mobile LiDAR point clouds[J]. Photogrammetric Engineering and Remote Sensing, 2012, 78(4): 331-338. DOI:10.14358/PERS.78.4.331 |

| [25] |

李鹏. 城市地物点云配准与典型要素提取[D]. 徐州: 中国矿业大学, 2018.

|

| [26] |

HU X, LI Y, SHAN J, et al. Road centerline extraction in complex urban scenes from LiDAR data based on multiple features[J]. IEEE Transactions on Geoscience & Remote Sensing, 2014, 52(11): 7448-7456. |

| [27] |

ZHANG W, LI W, ZHANG C, et al. Parcel based urban land use classification in megacity using airborne LiDAR, high resolution ortho-imagery and google street view[J]. Computers, Environment and Urban Systems, 2017, 64: 215-228. DOI:10.1016/j.compenvurbsys.2017.03.001 |

| [28] |

VLADIMIR K, EAMONN K, ROZENN D. Automatic discovery and geotagging of objects from street view imagery[J]. Remote Sensing, 2018, 10(5): 661-681. DOI:10.3390/rs10050661 |

| [29] |

LI X, ZHANG C, LI W. Building block level urban land-use information retrieval based on google street view images[J]. GIScience & Remote Sensing, 2017. DOI:10.1080/15481603.2017.1338389 |

| [30] |

DONG R, ZHANG Y, ZHAO J. How green are the streets within the sixth ring road of Beijing- an analysis based on tencent street view pictures and the green view index[J]. International Journal of Environmental Research and Public Health, 2018, 15(7): 1367-1389. DOI:10.3390/ijerph15071367 |

| [31] |

刘学军, 王美珍, 甄艳, 等. 单幅图像几何量测研究进展[J]. 武汉大学学报(信息科学版), 2011, 36(8): 941-947. |

| [32] |

中华人民共和国住房和城乡建设部, 中华人民共和国国家质量监督检验疫总局. 城市道路交通标志和标线设置规范: GB 51038-2015[J]. 北京: 中国计划出版社, 2015. |

| [33] |

中华人民共和国住房和城乡建设部. 城市道路工程设计规范: CJJ 37-2012[J]. 北京: 中国建筑工业出版社, 2012. |

| [34] |

任建平, 刘勇. 基于高分辨率影像的多尺度最优分割层次模型的城市道路网提取方法[J]. 兰州大学学报(自然科学版), 2019, 55(1): 42-50. |